Introl 博客

**

Introl 博客 **

非洲人工智能数据中心的蓬勃发展:尼日利亚、肯尼亚和南非的机遇

在尼日利亚、肯尼亚和南非等快速增长的市场的带动下,非洲正在成为世界下一个主要的人工智能基础设施前沿阵地。随着数十亿资金流入云地区、海底电缆、可再生能源和超大规模数据中心,非洲大陆正在加速进入数字化扩张的新时代。年轻、以移动为先的人口和金融科技的快速应用正在推动这一转变,从而创造了对计算、连接和云服务的强劲需求。对于投资者来说,非洲提供了难得的早期增长机会,其市场规模有望在 2027 年达到 50 亿美元。

拉丁美洲人工智能基础设施:巴西和墨西哥数据中心的机遇

圣保罗正在成为拉丁美洲的数据中心之都,拥有 100 兆瓦的容量。墨西哥的近岸外包热潮吸引了 500 亿美元的外国投资。AWS 对墨西哥云基础设施的 100 亿美元承诺也预示着拉丁美洲人工智能市场将迎来前所未有的机遇。巴西拥有 2.15 亿公民,是该地区最大的数字经济体,价值达 2000 亿美元。

打造您的人工智能基础架构团队:英伟达 2025 年认证路线图

GPU 工程师缺口达 85,000 人,薪资突破 35 万美元。英伟达每年仅认证 12,000 人,而需求量却高达 97,000 人。根据 2025 年路线图组建你的团队。

中东人工智能革命:阿联酋和沙特阿拉伯的千亿美元基础设施计划

沙特阿拉伯 5000 亿美元的 NEOM、阿联酋的人工智能部长以及卡塔尔 100 亿美元的数字基金都说明了人工智能引领增长的独特区域方法。在海湾地区 3 万亿美元财富的支持下,到 2030 年,人工智能基础设施投资将达到 1000 亿美元。微软、甲骨文和 AWS 等全球科技巨头正在投入大量资金。本分析比较了各国的战略,并展示了中东新兴的人工智能市场如何提供独特的国家模式和跨境机遇。

Google TPU v6e 与 GPU 的对比:每美元人工智能性能提升 4 倍指南

在人工智能培训方面,Google TPU v6e 的每美元性能是 GPU 的 4 倍。了解部署策略、成本分析和最佳使用案例

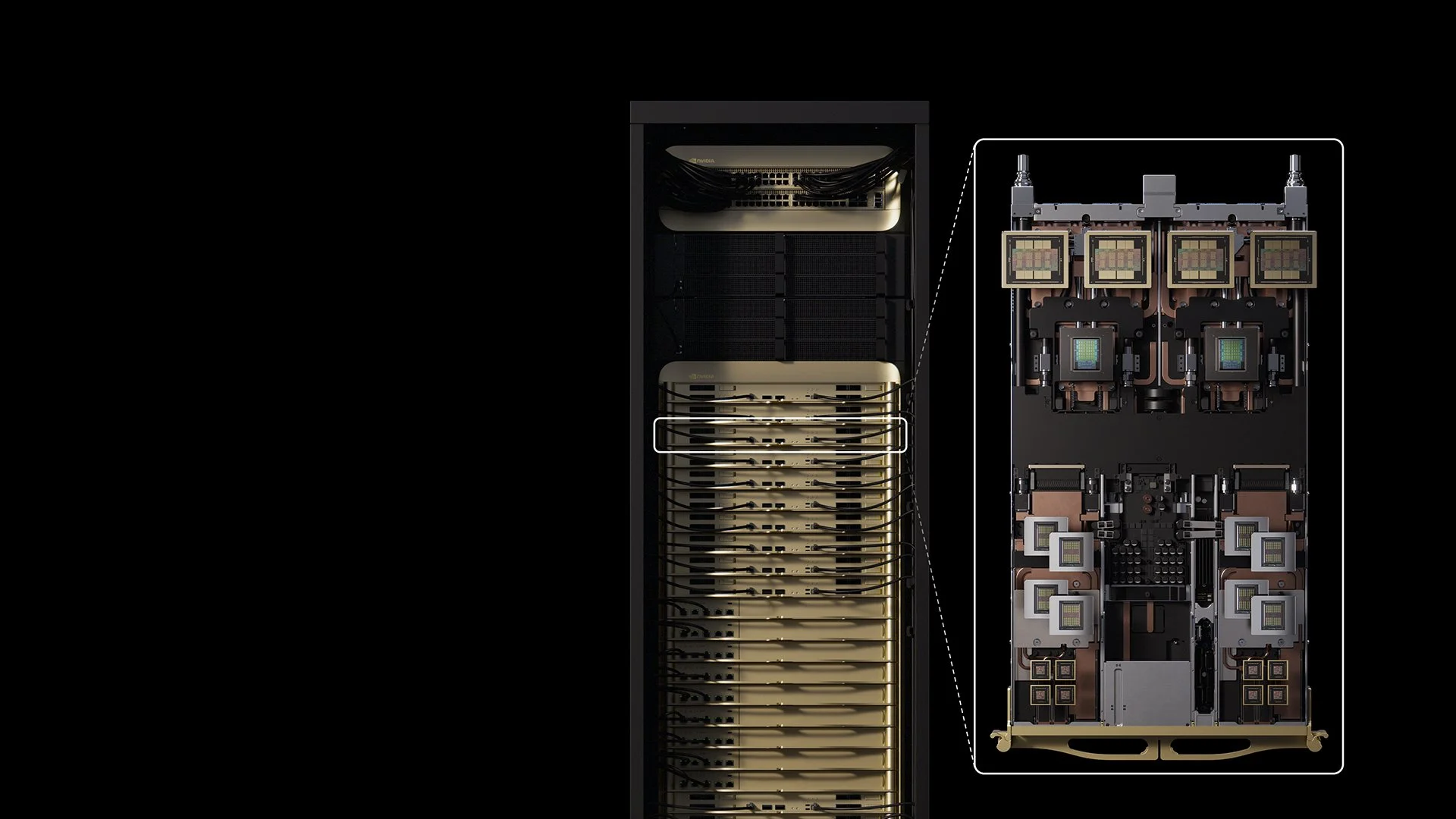

OpenAI-NVIDIA 1000 亿美元交易:10 千兆瓦人工智能基础设施

OpenAI 与英伟达公司(NVIDIA)宣布建立价值 1000 亿美元的合作伙伴关系,以部署 10 千兆瓦的人工智能基础设施,其中 Vera Rubin 平台将于 2026 年开始提供 8 exaflops 性能。

VVater 和 Introl 宣布合作重新定义人工智能数据中心的未来

VVater 与 Introl 合作,利用可持续水技术彻底改变人工智能数据中心。处理水量达 43 亿加仑,为 GPU 基础设施扩展节省 80% 的运营支出。

英伟达™(NVIDIA®)Vera Rubin 利用 600 千瓦机架和百万代币级内存打破 GPU 传统模式

英伟达™(NVIDIA®)Vera Rubin推动数据中心到2027年达到600千瓦机架,实现7.5倍的性能提升,同时要求对基础设施进行全面改造。

CoreWeave:人工智能基础设施革命--一家加密货币采矿初创企业如何成为价值 230 亿美元的人工智能中坚力量

CoreWeave 从加密货币挖矿转而成为价值 230 亿美元的人工智能基础设施骨干,在为 OpenAI 的基础模型提供动力的同时实现了 737% 的收入增长。

本地 LLM 硬件指南 2025:定价与规格

双 RTX 5090 与 70B 型号的 H100 性能相当,成本仅为 25%。从消费级 GPU 到企业级 GPU 的本地 LLM 部署的完整硬件定价指南。

OpenAI 的星际之门价值 5000 亿美元的合资企业为未来的人工智能提供动力

OpenAI 的星际之门是与软银、甲骨文和 MGX 共同出资 5000 亿美元成立的合资企业,正在建设全球最大的人工智能基础设施网络,为未来的人工智能革命提供动力。

Introl 在 2025 Inc.5000 中排名第 14 位,增长率达 9,594

Introl 在 Inc.5000 中排名第 14 位,增长率达 9594%,成为美国增长最快的 GPU 基础设施专家,为人工智能革命提供动力。

印度的 GPU 基础设施革命:从 8 万个 GPU 到 1,000 亿美元投资

到 2027 年,印度将部署 8 万多个 GPU,投资额达 1000 亿美元,年复合增长率达 34.4%,成为亚洲增长最快的人工智能基础设施市场。

英伟达™(NVIDIA®)Omniverse:价值 50T 美元的物理人工智能操作系统

英伟达™(NVIDIA®)Omniverse为252多家企业提供支持,提高效率30-70%。价值50万亿美元的物理人工智能操作系统改变了制造业、机器人技术和自动驾驶汽车。

英伟达™(NVIDIA®)FP4 推理实现 50 倍的效率

FP4 推理能效提高 25-50 倍,内存减少 3.5 倍。DeepSeek-R1 达到 250+ 代币/秒。0.02 美元/令牌时代到来。

马来西亚 150 亿美元的人工智能革命助力东南亚的数字未来

马来西亚获得 150 多亿美元的人工智能投资,部署了该地区首个 H100 GPU 平台。柔佛州转型为东南亚人工智能重镇,科技巨头竞相角逐。

小型模块化核反应堆 (SMR) 为人工智能提供动力:100 亿美元的核革命改变数据中心

科技巨头为小型模块化反应堆投入 100 多亿美元,为人工智能数据中心供电。首批 SMR 设施将于 2030 年投入使用,核能将满足人工智能 945 太瓦时的能源需求。

新加坡 270 亿美元的人工智能革命助力 2025 年的东南亚

新加坡承诺提供 16 亿美元的政府资金和 260 亿美元的技术投资,以成为东南亚的人工智能中心,其收入占英伟达全球收入的 15%。